创造历史!DeepSeek超越ChatGPT登顶中美AppStore

文章摘要

【关 键 词】 DeepSeek、AI技术、开源模型、复现挑战、Meta竞争

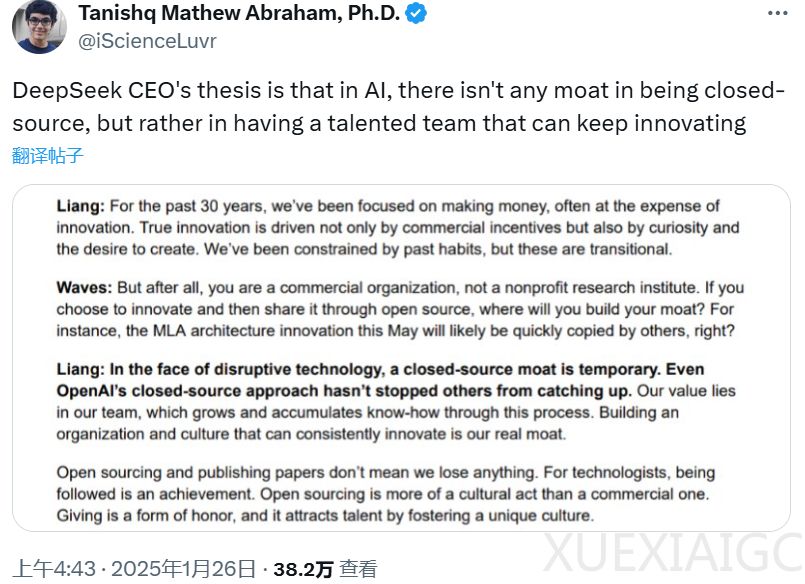

DeepSeek自20日发布以来,热度不减,其iOS应用甚至超越了ChatGPT官方应用,登顶AppStore。DeepSeek-R1迅速成为美国顶尖大学研究人员的首选模型,被认为可能是OpenAI与英伟达未曾预见的黑天鹅事件。围绕DeepSeek-R1的消息不断,Hugging Face等组织尝试复现R1,DeepSeek的采访被翻译成英文版在AI社区引发热议,Meta则陷入焦虑。

DeepSeek-R1虽开源,但未公布训练数据和脚本,不过技术报告提供了复现R1的指导方针。博主@Charbax总结了复现R1的难点,包括训练流程细节、冷启动数据生成、硬件和基础设施信息缺失等。尽管如此,一些团队已经开始行动,如Hugging Face的Open R1项目,宣称是DeepSeek-R1的完全开放复现,补齐了未公开的技术细节。该项目计划分三步实施:复现R1-Distill模型、复现DeepSeek用于创建R1-Zero的纯强化学习管线、通过多阶段训练从基础模型得到强化学习微调版模型。

香港科技大学的何俊贤团队基于7B模型,仅使用8K样本示例复现R1,结果惊人。他们从基础模型Qwen2.5-Math-7B开始,仅使用来自MATH数据集的8K样本直接对其进行强化学习,最终得到了Qwen2.5-SimpleRL-Zero与Qwen2.5-SimpleRL。

TinyZero项目尝试复现DeepSeek-R1-Zero,基于CountDown游戏实现,实验中模型逐渐发展出修改和搜索等策略。该项目的计算成本不到30美元。

Meta的生成式AI团队陷入恐慌,担心Llama的下一个版本性能不会像DeepSeek那样好。Meta暗示Llama的下一个版本将于本季度发布,并组织了四个作战室来学习DeepSeek的工作原理,考虑基于DeepSeek模型的新技术重构Meta模型。在DeepSeek的搅动下,新一年的大模型格局正在发生转变。

原文和模型

【原文链接】 阅读原文 [ 2257字 | 10分钟 ]

【原文作者】 机器之心

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★★★☆