单个4090就能跑,Mistral开源多模态小模型,开发者:用来构建推理模型足够香

文章摘要

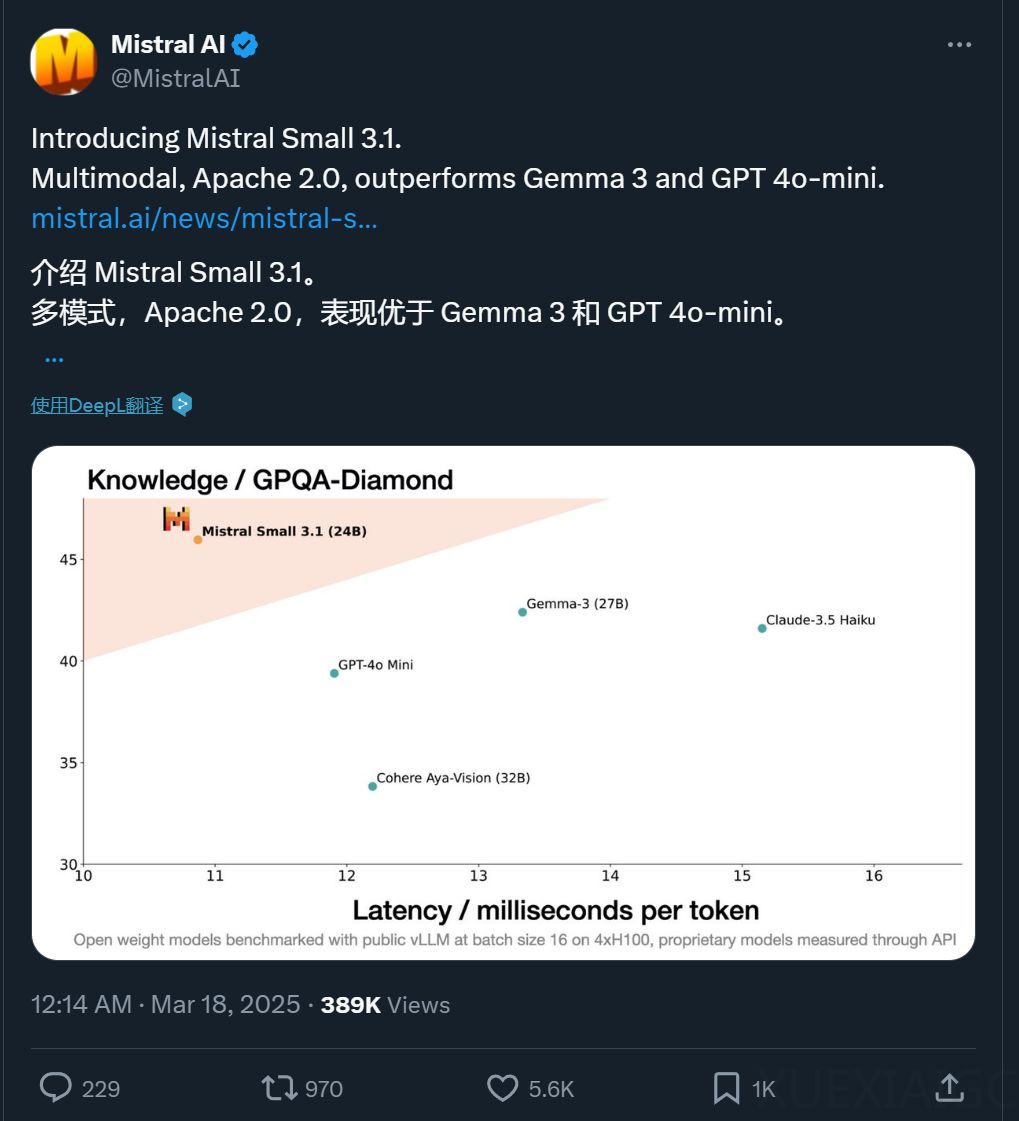

法国AI创企Mistral AI最近开源了一款名为Mistral Small 3.1的多模态小模型,该模型在多个基准测试中表现优异,超越了Gemma 3和GPT-4o Mini等同类模型。Mistral Small 3.1的推理速度达到了150个token/秒,并且能够在单个RTX 4090或32GB RAM的Mac上运行,显示出其高效性和易用性。该模型的开源协议为Apache 2.0,允许用户进行研究和商业应用。

Mistral Small 3.1是基于Mistral Small 3构建的,相比前代,它的上下文窗口从32k扩展到了128k,文本生成能力得到了显著提升,并且新增了视觉能力。Mistral官方表示,该模型是一款多功能模型,能够处理指令遵循、对话辅助、图像理解和函数调用等多种生成式AI任务,为企业级和消费级AI应用提供了坚实的基础。

该模型的核心特性包括轻量级、快速响应能力、低延迟函数调用、针对专业领域的微调能力以及作为高级推理的基础。Mistral Small 3.1的轻量级设计使其非常适合端侧使用,而快速响应能力和低延迟函数调用则使其在虚拟助手和自动化工作流中表现出色。此外,该模型可以针对特定领域进行微调,打造精准的主题专家,这在法律咨询、医疗诊断和技术支持等领域尤其有用。

Mistral Small 3.1的应用场景广泛,包括文档验证、诊断、端侧图像处理、质量检查的视觉检查、安全系统中的物体检测、基于图像的客户支持和通用协助等。开发者已经在自己的设备上完成了部署,并分享了体验效果,显示出该模型在实际应用中的潜力。

为了鼓励创新,Mistral AI发布了Mistral Small 3.1的基础模型和指令检查点,以便社区进一步对模型进行下游定制。开放的Mistral模型已经被开发者用来构建出色的推理模型,例如Nous Research的DeepHermes 24B就是基于Mistral Small 3构建出来的。这一举措不仅推动了AI技术的发展,也为企业和开发者提供了更多可能性。

原文和模型

【原文链接】 阅读原文 [ 726字 | 3分钟 ]

【原文作者】 机器之心

【摘要模型】 deepseek-v3

【摘要评分】 ★☆☆☆☆